نمونه گيري

تعريف نمونه گيري :

نمونه گيري فرآيند انتخاب مشاهده ها و تعميم نتايج مشاهده به كل جمعيت است.

دلايل نمونه گيري :

1.صرفه جويي در وقت، انرژي و هزينه.

2.جلوگيري از افزايش احتمال اشتباهات از قبيل اشتباهات پرسشگر و نيافتن پاسخگويان.

3.نتيجه نمونه گيري به شرط رعايت اصول و ضوابط آن ، با نتايج همه پرسي يكي است.

تاريخچه نمونه گيري :

نمونه گيري در علوم اجتماعي همگام با نظرسنجي سياسي، توسعه يافته است.

مجله آمريكايي ليترري دايجست در سال 1920 اسامي افرادي را از دفترچه هاي راهنماي تلفن و فهرست اسامي دارندگان خودرو انتخاب و اقدام به ارسال كارت پستالهايي براي آنان نمود. سردبيران اين مجله در اين كارت پستالها اين سؤال را مطرح كرده بودند كه از بين دو نامزد انتخابات رياست جمهوري به كدام يك رأي خواهيد داد. ليترري دايجست پس از دريافت پاسخها به درستي پيش بيني كرد كه چه كسي برندة انتخابات رياست جمهوري خواهد بود. اين مجله در دوره هاي بعدي انتخابات رياست جمهوري حجم نظرسنجي خود را گسترش داد و پيش بينيهاي آن در انتخابات رياست جمهوري سالهاي 1924، 1928 و 1932 درست از آب در آمد.

در سال 1936، اين مجله براي ده ميليون نفر برگه هاي نظرسنجي فرستاد و دو ميليون پاسخ دريافت كرد. در اين نظرسنجي 57 درصد شركت كنندگان به آلف لندون و 43 درصد به روزولت رأي داده بودند. اما پس از برگزاري انتخابات رياست جمهوري، نتايج كاملاً بر عكس بود و روزولت با 61 درصد آرا پيروز شده بود. اشتباه سردبيران ليترري دايجست در چهارچوب نمونه گيري آنها نهفته بود: دارندگان تلفن و مالكان خودروي شخصي. آنها نمونه اي از افراد ثروتمند را انتخاب كرده بودند.

اصطلاحات نمونه گيري :

1.عنصر : واحدي كه درباره اش اطلاعات جمع آوري مي شود و مبناي تحليل را فراهم مي سازد.

2.جمعيت : مجموعه افراد، اشياء يا نمودهايي كه يك يا چند صفت مشترك داشته باشند و يكجا در نظر گرفته شوند.

3.چهارچوب : فهرست اصلي واحدهاي نمونه گيري است كه نمونه يا مرحله اي از نمونه، از آن انتخاب مي شود.

4.متغير : صفات منحصر به فرد عنصرهاي يك جمعيت را توصيف مي كند.

5.نمونه : زيرمجموعه اي از يك جمعيت است كه براي استنباط ماهيت كل جمعيت انتخاب مي شود.

6.معرف بودن نمونه : همة اعضاي جمعيت بخت يكسان براي انتخاب شدن داشته باشند.

تعيين حجم نمونه :

تعيين حجم نمونه بستگي به ميزان دقت و اطمينان مورد نظر دارد كه با فرمولهايي قابل محاسبه است.

دو عامل خطاي نمونه گيري را كاهش مي دهد :

1.افزايش حجم نمونه.

2.افزايش همگوني عنصرهاي مورد انتخاب.

شيوه هاي نمونه گيري :

شيوه هاي نمونه گيري نسبت به مسائل مورد بررسي، متفاوت و تابع شرايط تحقيق است.

نمونه گيري غير احتمالي :

1.سهميه اي : بايد ساختار جامعه مورد مطالعه مشخص باشد و نياز به اطلاعات روزآمد دارد.

بايد همان نسبتهايي كه در جمعيت مورد مطالعه وجود دارد در نمونه انتخابي رعايت شود. مثال : افراد شاغل.

2.گلوله برفي : براي جمعيتهاي نادر كه محل استقرار آنها مشخص نيست مناسب است. عناصري از يك جمعيت، محقق را به عناصر ديگر اين جمعيت راهنمايي مي كنند. مثال : افراد بي خانمان، مهاجران غير قانوني.

3.هدفمند يا قضاوتي : نمونه بر اساس قضاوت شخصي يا اهداف مطالعه انتخاب مي شود.

نمونه گيري احتمالي (اتفاقي يا تصادفي) :

بايد فهرستي از افراد يا عناصر جمعيت مورد مطالعه در اختيار داشته باشيم.

1.ساده : از طريق قرعه كشي، استفاده از جداول اعداد تصادفي يا برنامه هاي رايانه اي.

2.سيستماتيك يا منظم : ابتدا حجم جمعيت را بر حجم نمونه تقسيم مي كنيم تا فاصله نمونه گيري بدست آيد. سپس يك عدد اتفاقي را مبناي شروع قرار مي دهيم و به اندازه فاصله نمونه گيري، افراد يا عناصر بعدي را انتخاب مي كنيم تا نمونه مورد نظر كامل شود.

3.خوشه اي : براي مناطق وسيع جغرافيايي كه بدست آوردن فهرست كاملي از اجزاي آن غير ممكن است بكار مي رود. در اين روش نقشه مورد مطالعه را به بخشهايي تقسيم مي كنيم سپس به روش اتفاقي ساده يا منظم از آن نمونه گيري مي كنيم.

دستور العمل براي انتخاب بهترين نمونه : به حداكثر رساندن تعداد خوشه ها و كاهش تعداد عناصر هر خوشه.

نمونه گيري خوشه اي با احتمال متناسب با حجم : در اين روش متناسب با حجم هر خوشه از آن نمونه گيري مي كنيم.

4.طبقه اي : براي جامعه آماري كه ساخت همگن و متجانس ندارد استفاده مي شود. اين روش خطاي نمونه گيري را كاهش مي دهد. در اين روش جمعيت مورد مطالعه را به زيرمجموعه هاي همگن تقسيم مي كنيم. مثال : اعضاي يك دانشگاه.

مزيتهاي نمونه گيري احتمالي :

الف- حذف سوگيري آگاهانه يا ناآگاهانه.

ب- امكان محاسبه درجه خطا.

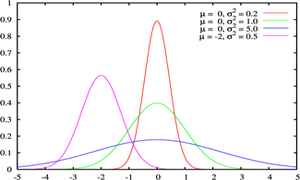

) و انحراف معیار(

) و انحراف معیار( ) ارتباط دارد. با وجود فرمول نسبتا" پیچیده و دخیل بودن پارامترهای ثابتی چون عدد (p) یا عدد (e) در این فرمول، می توان از آن برای مدل کردن رفتار میزان IQ، قد یا وزن انسان، پراکندگی ستارگان در فضا

) ارتباط دارد. با وجود فرمول نسبتا" پیچیده و دخیل بودن پارامترهای ثابتی چون عدد (p) یا عدد (e) در این فرمول، می توان از آن برای مدل کردن رفتار میزان IQ، قد یا وزن انسان، پراکندگی ستارگان در فضا

باشد در این صورت به آن تابع توزیع نرمال استاندارد گویند. در این حالت تابع توزیع به صورت زیر خواهد بود:

باشد در این صورت به آن تابع توزیع نرمال استاندارد گویند. در این حالت تابع توزیع به صورت زیر خواهد بود:

احتمال ظهور پیشامد E عبارت است از:

احتمال ظهور پیشامد E عبارت است از:

با تشکر از کسانی که با نظرات و انتقادهای خود باعث بالا رفتن کیفیت وبلاگ می شوند.

با تشکر از کسانی که با نظرات و انتقادهای خود باعث بالا رفتن کیفیت وبلاگ می شوند.